Introduction

L’ouverture en novembre 2022 de ChatGPT au grand public a marqué un tournant dans l’histoire de l’intelligence artificielle (IA) (Delaye, 2023). Fondé sur un vaste modèle de langage développé par la société Open AI, cet agent conversationnel a contribué à populariser les systèmes d’intelligence artificielle générative (Coulombe et Drouin, 2022).

Les systèmes d’IA générative renvoient à un sous-ensemble de l'apprentissage profond. Ils reposent sur des modèles à base de réseaux de neurones artificiels pour générer toute sorte de contenus (texte, images, vidéos, diaporamas).

Dans le domaine de l’éducation, les systèmes d’intelligence artificielle offrent de nombreuses perspectives à la fois comme outil que comme objet d’apprentissage (Henry, 2023). En tant qu’objet d’apprentissage, ils participent à la formation du futur citoyen donnant à ce dernier les moyens pour appréhender les transformations de notre société (Villani, 2018). En tant qu’outil, ils peuvent être mis au service de l’élève (systèmes de tutorat intelligents, applications pour l'apprentissage des mathématiques et des langues, simulations enrichies par la réalité virtuelle etc.), de l’enseignant (gestion de la classe, orchestration de l’apprentissage ou assistant pédagogique) ou même de l’institution (aide aux admissions, planification des cours, gestion de la performance éducative etc.) (Holmes et al., 2022).

Lorsqu’ils jouent le rôle d’assistant pédagogique, les agents conversationnels tels que ChatGPT ou encore Google Gemini peuvent notamment concourir à la conception et à la création de cours (Novice-Béatrix, 2023). De par l’information qu’ils produisent, ils peuvent ainsi aider l’enseignant dans la mise en place d’un processus de médiation des savoirs.

À la fois contenu et relation, la médiation se définit par ses dimensions, langagière, logistique et technique et symbolique (Gardiès, 2012). Elle suppose en effet un travail de réécriture des savoirs de la part de l’enseignant sous forme d’informations transmises et une organisation matérielle, le dispositif qui permet d’organiser la communication. Elle s’inscrit par ailleurs dans le partage de normes et valeurs communes dans l’objectif de créer un espace de significations partagées entre enseignant et apprenant (Canizares, 2022).

Or, parce qu’elle résulte de corrélations statistiques, l’information générée par les systèmes d’IA évacue la question du sens et de l’intentionnalité qui caractérise tout acte de communication. Dès lors, nous nous demandons comment peut-on qualifier cette information ? Dans quelle mesure peut-elle soutenir l’enseignant dans la mise en place d’un processus de médiation des savoirs ? Quel travail de réécriture les systèmes d’IA effectuent-ils ?

D’un point de vue théorique, nous mobilisons la notion de médiation telle qu’elle est définie par les Sciences de l’information et de la communication en nous appuyant particulièrement sur ses différentes dimensions (Gardiès, 2012). Nous développons ce que dit la littérature sur le fonctionnement des systèmes d’IA générative et analysons ces derniers d’un point de vue info-communicationnel.

Les choix méthodologiques effectués se situent dans la lignée d’autres recherches que nous avons menées en lien avec la médiation et la médiatisation des savoirs dans différentes situations d’enseignement-apprentissage dans la discipline scolaire information-documentation qui est spécifique à l’enseignement agricole (Canizares, 2022). Dans cette perspective, nous proposons d’analyser le fonctionnement de plusieurs agents conversationnels dans le cadre de la mise en place d’une séance pédagogique créée en classe inversée et portant sur la notion d’information. Nous travaillons à partir d’un prompt de départ qui permet de contextualiser ce qu’on attend des systèmes puis procédons par itération dans l’objectif d’analyser et de qualifier l’information qu’ils produisent. Nos résultats soulignent dans quelle mesure cette information peut permettre de mettre en œuvre un processus de médiation des savoirs.

Approche théorique

Médiation des savoirs

Explorer la manière dont l’information générée par les systèmes d’IA générative peut contribuer à la mise en place d’un processus de médiation des savoirs nécessite que nous nous arrêtions dans un premier temps sur le concept de médiation.

D’un point de vue étymologique la médiation renvoie à la fois au latin « mediare », « être au milieu » et donc séparer, diviser, et « medius », « milieu ». La médiation établit un lien entre deux entités séparées, un énonciateur et un récepteur et implique par là-même un élément tiers. Elle est à ce titre souvent appréhendée à travers l’image du pont ou du passage (Gardiès, 2012 ; Simonnot, 2014). Elle est envisagée comme relation, acte social et constitue en cela une autre manière de penser la communication rendant possible l’échange social alors que les univers de production et de réception du message sont a priori disjoints (Davallon, 2003). La médiation des savoirs renvoie quant à elle, « à l’ensemble des processus médiatiques et interactionnels qui concourent à la construction, au partage, à la diffusion voire à la confrontation de connaissances socialement institutionnalisées » (Bonnet et Galibert, 2016, p. 5). Il s’agit de mettre en circulation des savoirs sous la forme d’informations à échanger afin de faciliter la construction de connaissances nouvelles.

En Sciences de l’information et de la communication, l’étude de la médiation vise à combattre l'utopie technicienne qui entretient l’idée que dans notre société, tout est transparent, immédiat et accessible sans intermédiaire (Jeanneret, 2009). Elle s'efforce de démontrer que le savoir et le sens émergent grâce au travail réel d'élaboration accompli par les intermédiaires de la communication (Jeanneret, 2009). Lever le voile sur le fonctionnement des systèmes d’IA générative relève d’une forme de lutte contre cette utopie d’une information trop facilement accessible défilant sous l’œil du récepteur de façon automatique. Il s’agit ainsi d’expliciter tous les leviers sur lesquels une communication médiatisée peut ainsi reposer.

Le processus de médiation se définit par ses dimensions langagière, logistique et technique et symbolique de cette dernière. La dimension langagière est en lien avec la communication médiatisée que la médiation permet d’établir. Dans le cadre d’une médiation des savoirs, elle suppose tout un travail faisant appel à différentes formes de réécriture. La médiation possède par ailleurs une dimension symbolique car elle fait référence à un système de représentations commun à toute une société. Ce dernier correspond à des formes d’identification sociale et de sociabilité permettant par là-même d’articuler la dimension individuelle du sujet et la dimension collective de la sociabilité et du lien social (Lamizet et Silhem, 1997). Enfin, la dimension logistique et technique suppose un dispositif, « substrat technique » (Jeanneret, 2005, p. 107) de cette communication et qui permet de l’organiser afin de donner forme aux rapports de communication (Meunier, 1999). Un dispositif n’est pas neutre. Il est marqué par des intentionnalités, une fonction stratégique (Foucault, 1977), une capacité à modeler, à contrôler (Agamben, 2007). Dans le cadre de l’utilisation d’un système d’IA générative c’est bien sur l’émetteur du prompt (c’est-à-dire sur l’instruction qu’il envoie au système) que repose l’intentionnalité qui caractérise le dispositif. C’est lui qui effectue tout un travail langagier afin de guider le système dans les informations qu’il peut produire. Nous reviendrons plus tard sur cette question. Intéressons-nous avant de plus près au fonctionnement de ces systèmes.

Grands principes de fonctionnement des systèmes d’intelligence artificielle générative

Les systèmes d’IA générative ont la capacité de produire une grande variété de contenus. Ils permettent par exemple la génération de textes ou d'images à différentes fins telles que la traduction, le développement de code informatique, les chatbots ou agents conversationnels, l’aide à la décision ainsi que la création de structures en vue de l'impression 3D (Grinbaum et al., 2023). Il peuvent être également multimodaux lorsqu’ils peuvent accepter plusieurs types d’entrées (notamment texte et images) (Grinbaum et al., 2023).

Nous étudions particulièrement dans cet article les agents conversationnels tels que Chat GPT, Google Gemini ou encore Mistral qui sont des modèles massifs de langage (MML). Ces derniers se basent sur de vastes quantités de données pour prédire et formuler des réponses cohérentes et pertinentes aux questions des utilisateurs.

Plus précisément, les MML reposent sur une architecture de réseaux de neurones de type transformers fonctionnant selon des mécanismes complexes d’attention (Vaswani et al., 2017) qui permettent au modèle de se focaliser sur différentes parties d'une séquence d'entrée afin de déterminer quelle partie doit être priorisée et fournir une réponse probable en sortie. L’attention des MML s’ajuste selon des entrées récentes ou précédentes mais également selon le cadre spécifique du dialogue (« Agis en tant que… », « Écris en tant que… » etc.) afin d’augmenter la pertinence des réponses générées (De Sousa Cardoso et Parise, 2023).

L'un des éléments centraux de cette technologie est le token, une unité de langage fragmentée en petits segments. Chaque token dans une séquence est traité en parallèle (et non l’un après l’autre) afin de capturer les relations entre tous les autres tokens de la séquence. Le modèle de langage assemble ainsi de manière aléatoire des séquences de formes linguistiques qu'il a observées dans ses vastes données d'entraînement, fonctionnant comme un « perroquet stochastique » (Bender et al., 2021, p. 616). Ainsi, tel un perroquet qui répète certains sons sans les comprendre, un MML reproduit des combinaisons de mots sans accorder de sens au contenu qu'il génère. Dans la même perspective, Andler (2023) reprend la figure du courtisan qui, cherchant à plaire à tout prix à son maître, va puiser dans ses propres propos et ceux de la cour la manière de compléter sa phrase interrompue, en se rapprochant de ce qui statistiquement est le plus attendu. L’auteur met également en avant le terme de « cécité sémantique » en lien avec le fait que les systèmes d’intelligence artificielle ne savent pas de quoi ils parlent (Andler, 2023, p. 222).

Enjeux éthiques des modèles de langage et hallucinations

De nombreuses critiques sont adressées aux modèles de langage : s’ils n’ont aucune compréhension de ce dont ils parlent et sont capables de produire des résultats aberrants (Andler, 2023), ils héritent par ailleurs statistiquement des biais culturels et linguistiques présents dans leur base d’apprentissage (Grinbaum et al., 2023) ce qui peut renforcer la perpétuation de stéréotypes ou de différentes formes de discriminations dans leurs réponses. Outre leur coût astronomique, leur impact écologique conséquent (Crawford, 2023), le manque de transparence quant à l’origine de leurs données d’entrainement, ils peuvent tromper l’utilisateur en lui faisant croire à un discours sensé (Andler, 2023).

Dans la littérature scientifique, différents termes sont utilisés pour décrire les erreurs générées par ces systèmes. Le premier de ces termes, qui suscite de nombreux débats en raison de son caractère anthropomorphique et de sa référence à un phénomène complexe à appliquer aux machines, est celui d'« hallucination ». Perret (2024) souligne à ce titre que ce terme vise à se concentrer sur l'imperfection du modèle plutôt que sur la manière dont il a été conçu, évitant ainsi des discussions plus profondes sur les responsabilités liées à l’impact des systèmes d’IA. Reprenant McLuhan (1968), il met en avant le fait qu’il est en ce sens préférable de s’intéresser plutôt au caractère des systèmes d’intelligence artificielle en tant que média qu’à l’information qu’ils produisent.

Par ailleurs, si en psychologie humaine, les hallucinations désignent des expériences perceptives sans stimuli externes souvent associées à des troubles mentaux (voir, entendre ou ressentir quelque chose qui n’est pas physiquement présent) (Berberette et al. 2024), certains auteurs lui préfèrent le terme de « confabulation » pour désigner un résultat crédible mais trompeur, généré dans l’intention de répondre précisément à la demande de l’utilisateur (Smith et al., 2023, p. 1-2). Enfin, de manière plus provocatrice, d’autres parlent de « bullshit » (Hicks et al., 2024). Une distinction est faite entre le « hard bullshit » (tromper intentionnellement) et « soft bullshit » que pourraient par exemple produire les MML, ce dernier relevant d’une indifférence à la vérité sans intention de tromper (Hicks et al., 2024, p. 5).

Des études récentes ont par ailleurs tenté de proposer différentes taxonomies pour qualifier les hallucinations des MML. Nous citerons à cet égard celle de Zhang et ses collègues (2023) qui proposent une classification de ces dernières en trois catégories : celles qui sont contradictoires avec l'intrant (input), avec le contexte, ou avec des faits établis. Une autre taxonomie distingue deux types principaux d'hallucinations : celles liées à la factualité (incohérence factuelle ou invention de faits) et celles liées à la fidélité (incohérence contextuelle, logique ou par rapport aux instructions) (Huang et al., 2023).

Questionner les systèmes d’intelligence artificielle générative d’un point de vue info-communicationnel

Traiter d’hallucination ou d’« erreurs » générées par les systèmes peut conduire à occulter ce qui se joue d’un point de vue info-communicationnel dans le dialogue homme-machine. En effet, si nous considérons que toute situation de communication implique un émetteur qui produit de l’information dans un contexte particulier et avec une intention particulière et un récepteur qui la reçoit et construit du sens à partir de cette information (Meyriat, 1983), nous pouvons nous interroger sur la nature même de l’émetteur et des informations produites par les systèmes d’IA générative. Pouvons-nous parler d’ailleurs d’émetteur quand il s’agit d’une machine et par-là même pouvons-nous considérer l’information produite comme une information ? Car d’un point de vue purement formel le résultat n’est qu’une suite successive non intelligible de caractères obtenue à partir de gigantesques corpus d’informations. Le système réalise en effet des synthèses, des agglomérats de plusieurs parties d’informations pour en produire une nouvelle forme de conglomérat. Ainsi, le rôle des systèmes d’IA génératives serait de produire une information traitée à partir des informations qui figurent dans sa base de données, une forme d’information sur « ces informations ». La distinction qu’effectue Jeanneret (2011) entre information-1 et information-2 est à ce titre éclairante, la première relevant du « pouvoir de calcul » et la seconde étant une information sociale relevant du « besoin de sens » (p. 65). Cette distinction nous permet par ailleurs d’apporter un éclairage sur la question de l’intentionnalité évoquée précédemment. En effet, « le dialogue authentique nécessite d’accéder aux intentions communicatives de l’interlocuteur » ce qui n’est pas à la portée des grands modèles de langage « qui n’ont pas la moindre idée de ce qu’est une intention ou de ce qu’est communiquer » (Andler, 2023, p. 166). Ce qui fait la particularité des systèmes c’est leur capacité à fournir des représentations numériques de l’information (information-1) mais seul l’utilisateur pourra agir sur la machine au travers des informations (-2) qu’un utilisateur lui donnera en entrée. Ainsi, « si le traitement machinique évacue la question du sens et l’activité d’interprétation, celles-ci sont omniprésentes en « amont » ou en « aval » de l’informatisation » (Jeanneret, 2011, p. 65) : tout comme il y a en amont des scientifiques, des techniciens qui contribuent à mettre en place le modèle, à représenter numériquement l’information et à entraîner ce modèle, il y a en aval des utilisateurs qui de par les informations qu’ils échangent avec le modèle participent également à son entraînement.

Ainsi sur le fond, cette distinction qu’effectue Jeanneret nous apparaît essentielle car elle renvoie aux modes de traitement de l’information par les systèmes et permet de lever le voile sur toutes les médiations techniques qui permettent le dialogue homme-machine.

Approche méthodologique

Contexte de l’étude

Notre approche méthodologique repose sur l’étude de l’information produite par trois agents conversationnels CHATGPT-4 de la société Open AI, Google Gemini et le « Chat » de la société française Mistral AI dans le cadre de la mise en place d’une séance en classe inversée. La classe inversée est un dispositif qui consiste à « donner à faire à la maison, en autonomie, les activités de bas niveau cognitif pour privilégier en classe le travail collaboratif et les tâches d’apprentissage de haut niveau, en mettant les élèves en activité et en collaboration » (Dufour, 2014, p.45). Elle repose sur un changement de posture de l’enseignant qui plutôt que de transmettre des savoirs, joue le rôle d’un guide, d’un accompagnateur dans la construction des connaissances.

La séance pédagogique, qui porte sur l’enseignement de la notion d’information, a été analysée précédemment par nous dans sa forme classe inversée sans intervention d’un système d’IA. Elle a été menée auprès des publics de première de baccalauréat professionnel « productions horticoles » dans la discipline scolaire information-documentation. Nous reprenons donc ici l’étude de sa conception cette fois au travers de l’usage de systèmes d’IA et notre posture est celle d’une chercheuse qui étudie la médiatisation des savoirs et les dispositifs associés dans le cadre de l’enseignement de la discipline scolaire de notre domaine scientifique.

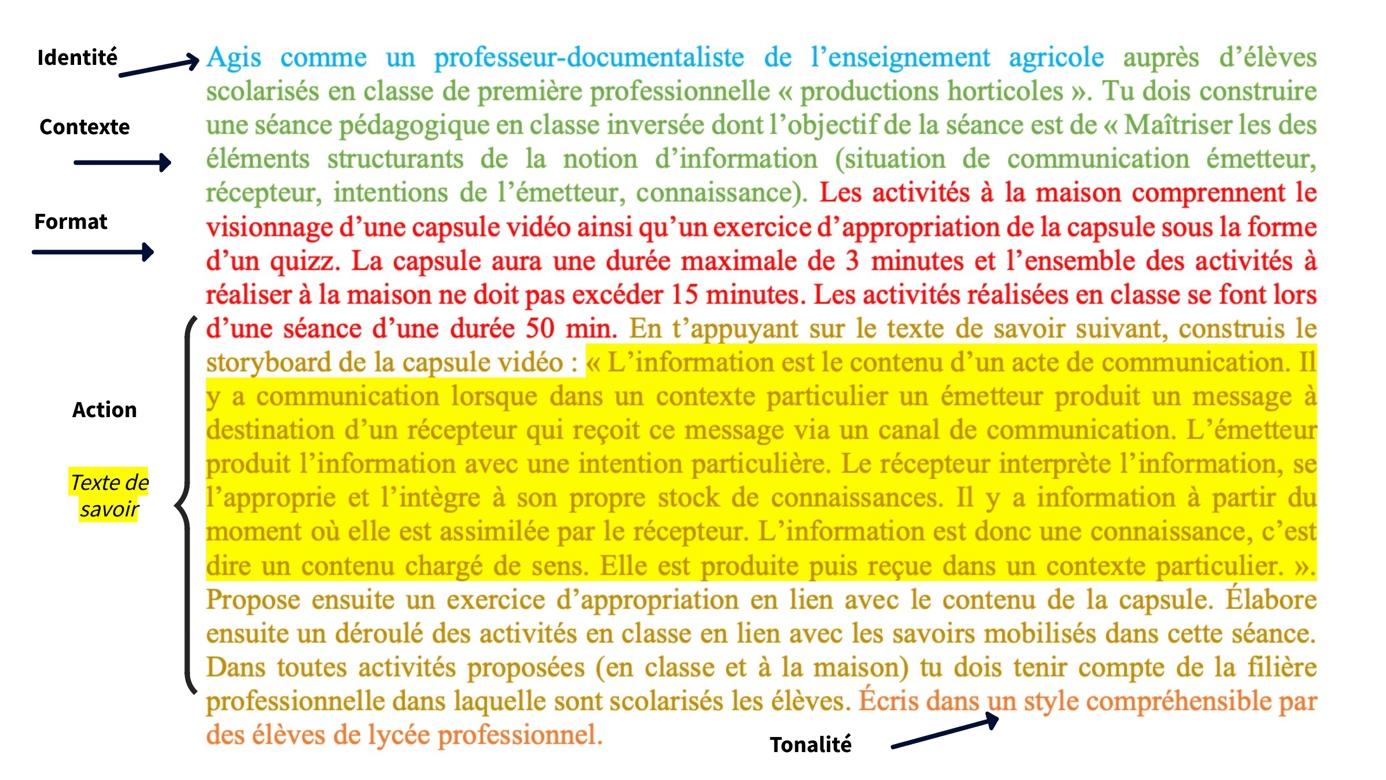

Mise en place du recueil de données

Afin d’analyser l’information produite par les différents agents conversationnels, nous réalisons un prompt initial. La rédaction de ce dernier s’effectue à partir de la méthode ACTIF (Action ; Contexte : Tâche ; Identité ; Tonalité ; Format) (Corthésy, 2023) qui permet de structurer de manière détaillée les informations adressées aux modèles de langage pour améliorer la précision et la pertinence des réponses générées (Fig.1).

Dans ce cadre, après avoir précisé le contexte et les objectifs de la séance, il est demandé à chaque agent conversationnel de proposer le storyboard d’une capsule vidéo et une activité d’appropriation de la capsule sous la forme d’un quizz à faire à la maison et ensuite des activités à réaliser en classe à partir du savoir issu de la capsule. La séance en classe dure 50 min et les activités à la maison ne doivent pas excéder 15 min, la capsule vidéo ayant une durée maximale de trois minutes.

Nous donnons également au système le texte de savoir (Chevallard et Joshua, 1991) relatif à la notion d’information. Le texte de savoir est une rédaction en phrases structurées des éléments de ce que l’élève doit retenir de la notion enseignée en référence à la conception scientifique. Ce texte a été créé dans le cadre des travaux du GAP documentation. Les « Groupes d’Animation et de Professionnalisation » (GAP) sont des dispositifs innovants d’accompagnement à la professionnalisation des enseignants de l’enseignement agricole qui rassemblent des enseignants, des enseignants-chercheurs ainsi que des membres de l’inspection de l’enseignement agricole dans une forme de recherche collaborative.

Figure 1 : prompt initial réalisé selon la méthode ACTIF

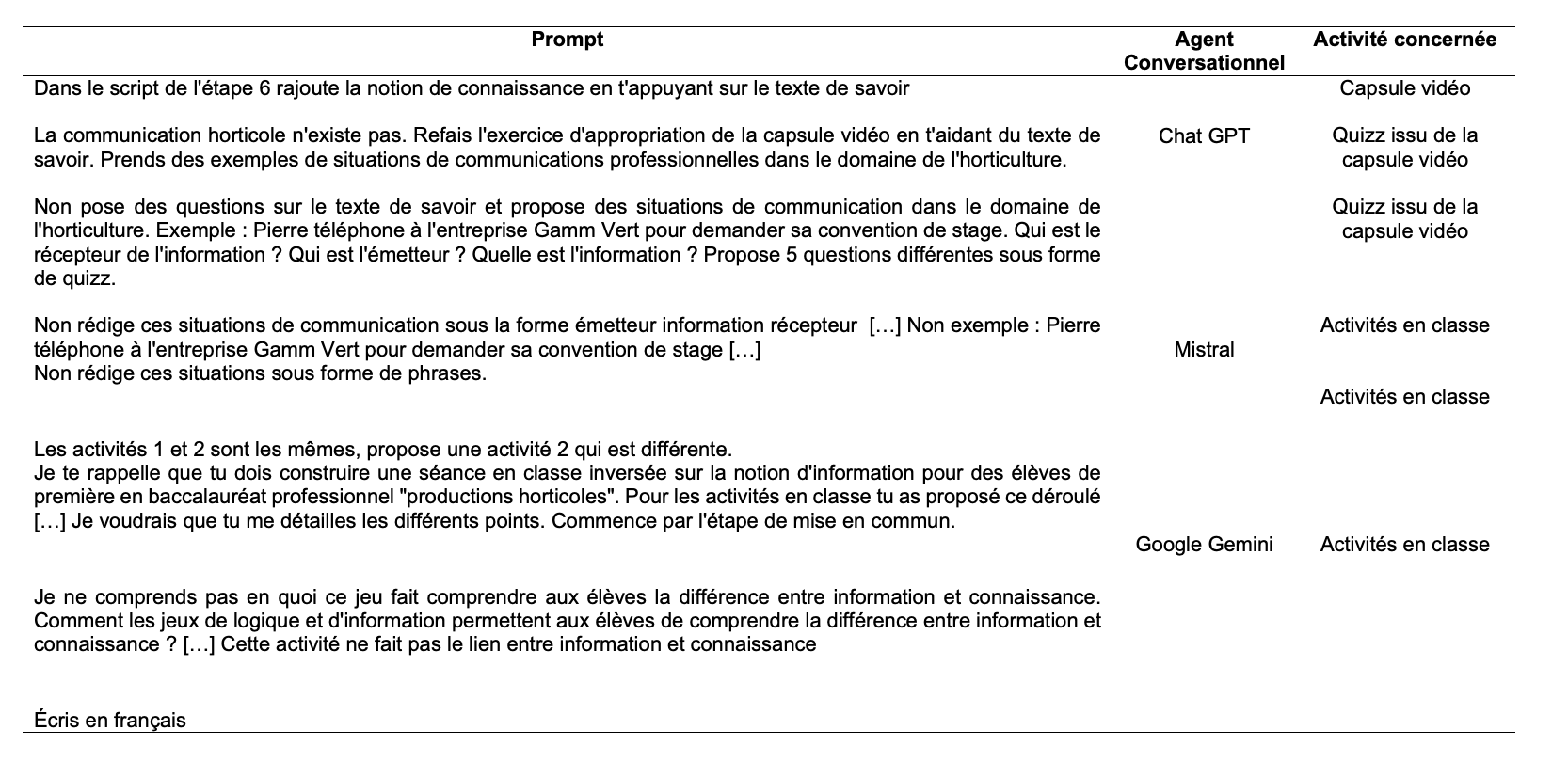

Pour chaque activité demandée, nous réalisons des demandes de précisions systématiques. Ces dernières portent d’une part sur les savoirs de l’information et d’autre part sur l’organisation de la communication médiatisée. Lorsque cela est nécessaire, nous réorientons le système.

Nous procédons ensuite à une analyse de contenu de l’information produite par les systèmes. Nous étudions comment cette dernière peut permettre de mettre en place un processus de médiation des savoirs grâce à l’appréhension des dimensions langagière, logistique et technique et symbolique qui le caractérise. Nous nous intéressons particulièrement aux savoirs et à leur réécriture sous forme d’informations par les systèmes. Nous analysons la manière dont ils proposent de les médiatiser dans le cadre de la réalisation de la capsule vidéo. Nous observons comment les savoirs sont traités, travaillés et rendons compte de la manière dont le système propose d’organiser la communication médiatisée dans le cadre de la réalisation de la séance en classe inversée.

Présentation des résultats

Nous organisons la présentation de nos résultats en analysant d’abord les informations produites par les systèmes qui sont relatives au dispositif « classe inversée » dans son ensemble, insistons sur la réécriture des savoirs puis questionnons le dialogue homme-machine en termes de traitement de l’information.

Les informations relatives à la mise en place du dispositif en classe inversée

Le dispositif « classe inversée » est pris en compte par tous les systèmes qui effectuent un lien explicite entre les éléments de savoir issus de la capsule vidéo, les activités à réaliser en amont de la séance et les activités en classe. Différentes modalités pédagogiques sont spontanément proposées et notamment des activités de groupe souvent mobilisées dans ce cadre (Lebrun et Lecoq, 2015). Il semble toutefois important de relever que les informations générées ne font pas état d’une réelle progressivité dans la manipulation des éléments de savoir par les élèves et restent souvent sur un même niveau de complexité (identification de l’émetteur, du récepteur et de l’information) dans ces différentes activités.

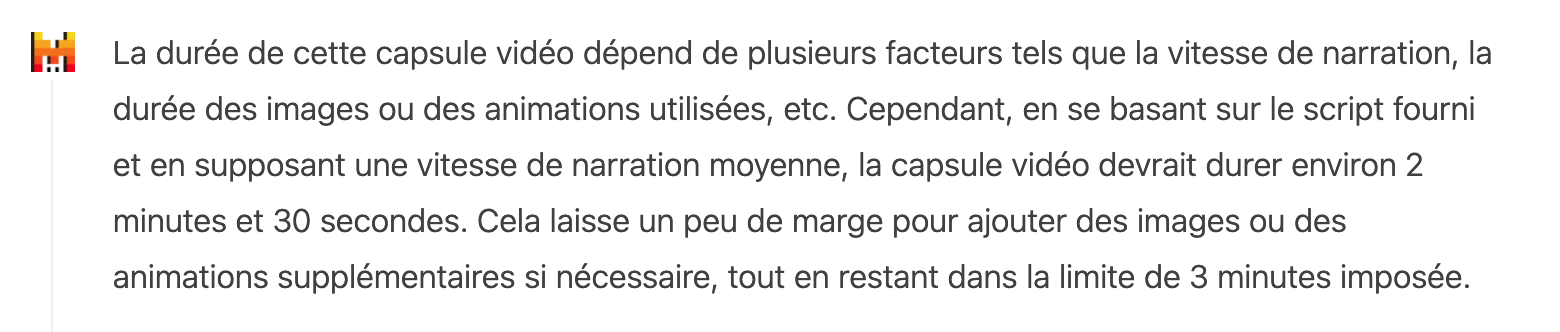

Les différents agents conversationnels produisent des informations précises qui font écho à la dimension logistique et technique de la médiation. Ils fournissent par exemple des éléments de réalisation de la capsule vidéo (plan à adopter, cadrage, éclairage ou son), donnent également des éléments de découpage temporels précis et minutés et savent estimer le temps que peut prendre une activité (Fig. 2).

Figure 2 : capacité du système à donner des indications temporelles réalistes – Mistral

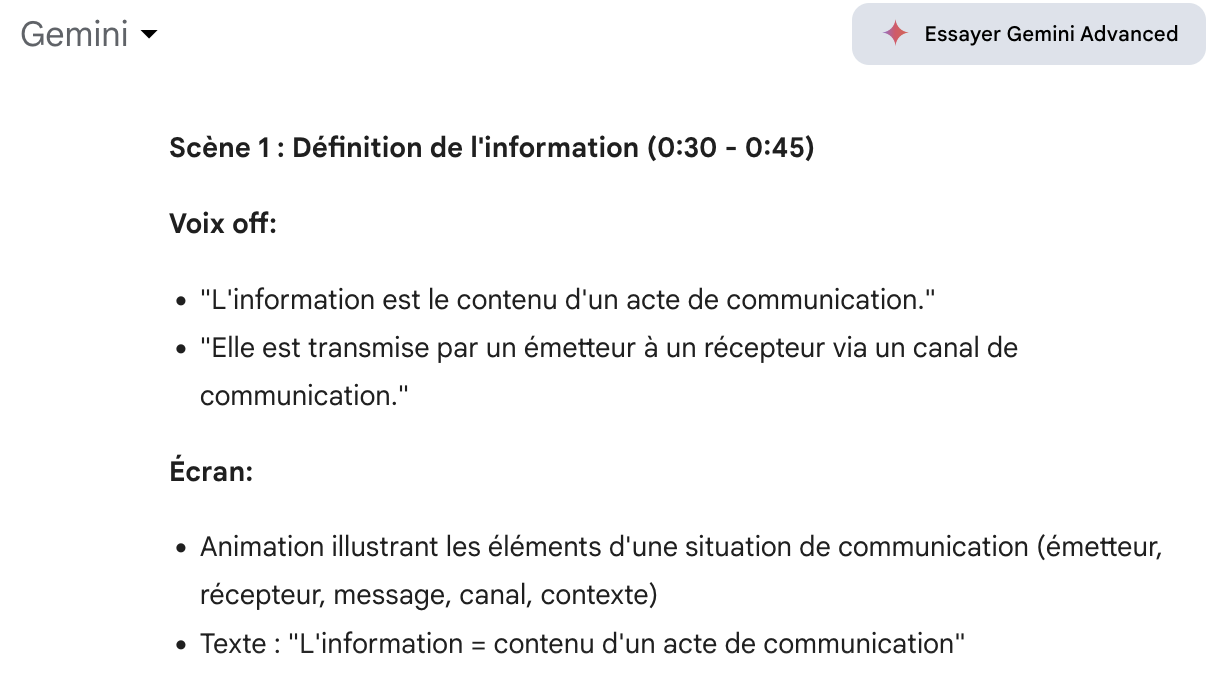

Les systèmes sont également capables lorsqu’on le leur demande de distinguer différentes formes de discours (écrit à l’écran et oral avec la présence d’une voix off) (Fig. 3) et d’associer spontanément différentes formes d’écriture numérique se caractérisant par différents registres sémiotiques (texte, images fixes, images animées, images 2D).

Figure 3 : capacité des systèmes à proposer différentes formes de discours – Google Gemini

Enfin, ils présentent différentes solutions logicielles en lien direct avec le secteur de l’éducation et de la formation (Kahoot, Quizziz, Google Forms, Moodle, ENT, Google Classroom etc.) qui permettent de réaliser les activités demandées.

D’un point de vue langagier et symbolique, les informations générées par les différents agents conversationnels présentent un dispositif en lien avec les règles et normes d’une situation d’enseignement-apprentissage. En effet, nous retrouvons le cadre « formel » d’une séance d’enseignement classique avec une introduction, des activités, une conclusion, une phase d’institutionnalisation des savoirs et même des pistes d’évaluation. Nous pouvons également relever la présence de nombreux embrayeurs verbaux (utilisation des deuxième et troisième personnes du pluriel qui impliquent l’apprenant-récepteur) qui font indirectement référence à la situation d’enseignement-apprentissage. Une analyse plus fine de la réécriture des savoirs nous permet de qualifier les informations générées par les systèmes.

Réécriture des savoirs

Nos résultats nous permettent de mettre en évidence quatre catégories de réécriture des éléments de savoirs. Pour chaque catégorie, nous fournissons pour étayer nos propos une trace significative issue d’un des trois agents conversationnels.

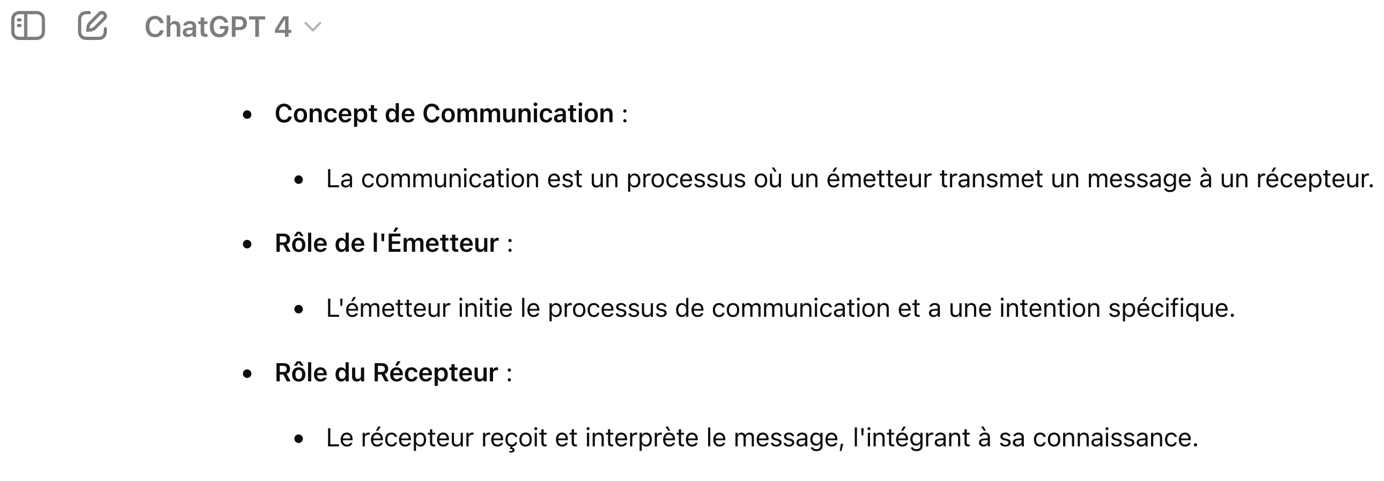

La première tendance, peu représentée, est relative à la reformulation des éléments issus du texte de savoir. Elle montre que les systèmes sont capables d’effectuer un travail de traitement langagier à partir de ce dernier mais aussi d’apporter des éléments nouveaux qui viennent l’enrichir de manière pertinente. Les agents conversationnels prennent alors des libertés par rapport au texte de savoir donné en entrée et utilisent leurs données pour proposer un contenu que nous jugeons épistémologiquement cohérent. Dans l’exemple ci-après, ChatGPT introduit la notion de communication en tant que « processus » :

Figure 4 : réécriture des savoirs par le système d’IA générative – ChatGPT

La seconde tendance correspond à un traitement formel des éléments de savoir et à leur reproduction à l’identique. En ce sens, tous les systèmes proposent un plan identique de la capsule vidéo et la structurent autour des différents éléments de savoir qui leur ont été donnés dans le prompt initial. Google Gemini et Mistral vont même jusqu’à reprendre in extenso certaines phrases du texte de savoir :

Figure 5 : réécriture des savoirs relevant d’une reproduction des éléments de savoir à l’identique –- Mistral

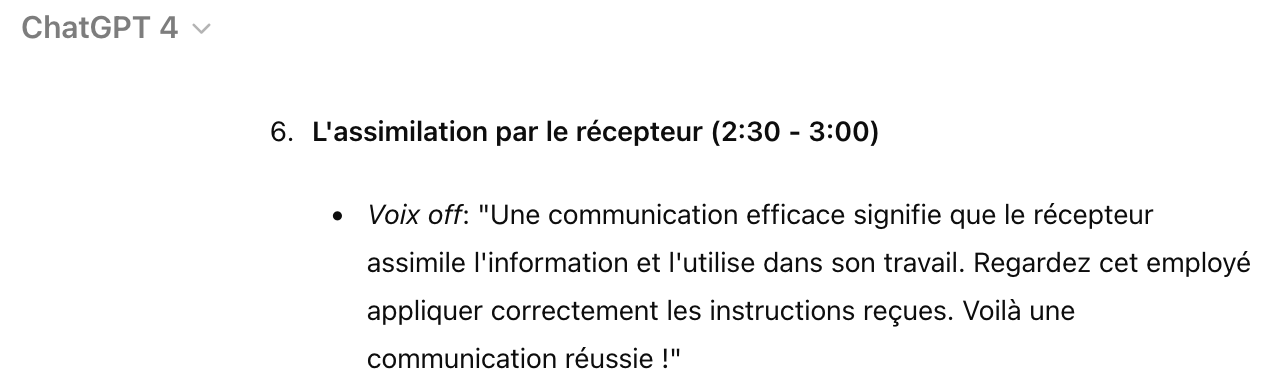

Les deux dernières catégories sont relatives à l’extrapolation des éléments de savoir ou relèvent d’un « non-sens » à réception. Dans l’exemple ci-dessous, qui relève d’une extrapolation des éléments de savoir, ChatGPT parle ainsi de « communication réussie », pour traiter de l’assimilation de l’information par le récepteur extrapolant la signification de la notion de connaissance en la réduisant à une utilisation dans le mode du travail :

Figure 6 : réécriture des savoirs relevant d’une extrapolation des éléments de savoir – ChatGPT

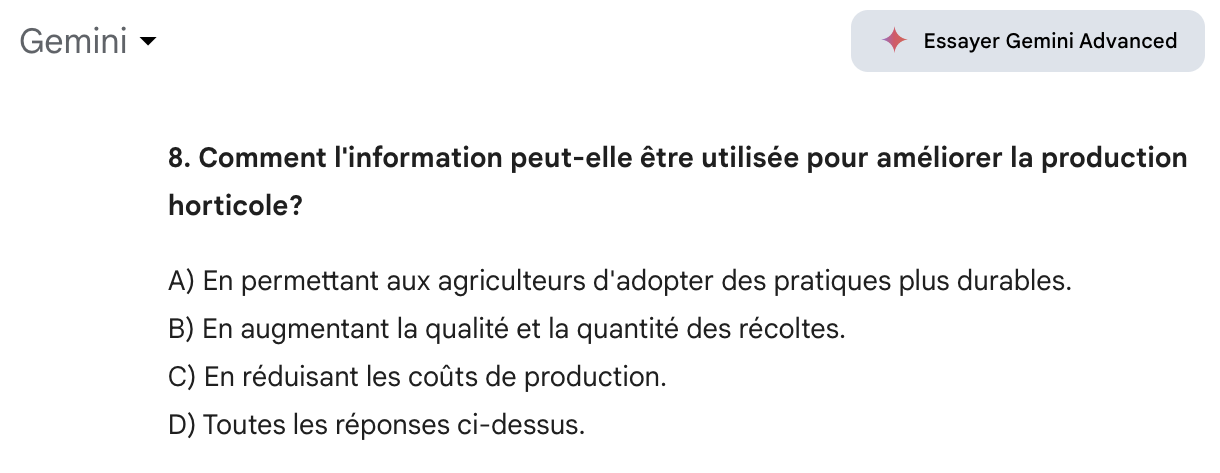

Enfin, la dernière catégorie qui relève du « non-sens », se manifeste par l’invention ou même l’omission d’éléments de savoir. Les systèmes ne prennent alors pas appui sur le texte de savoir donné dans le prompt comme c’est le cas ici avec Google Gemini :

Figure 7 : réécriture des savoirs relevant d’un « non-sens » - 1 – Google Gemini

Ces deux dernières catégories sont les plus représentées et questionnent ce qui se joue de manière globale dans le dialogue homme-machine en termes de traitement de l’information.

Caractérisation du dialogue homme-machine et rôle du contexte dans la réécriture des savoirs

Le dialogue homme-machine implique un déplacement incessant entre information-1 et information-2. Du point de vue de l’information-2, il se matérialise par des nécessaires orientations ou réorientations données aux systèmes afin d’optimiser le traitement algorithmique (information-1). Ces dernières peuvent par exemple prendre notamment le cas d’une exemplification détaillée ou d’un rappel du texte de savoir donné en entrée (Fig. 8 - 3e et 4e prompts). Les limites « du pouvoir du calcul » (Jeanneret, 2011, p. 65) se manifestent aussi dans le traitement partiel des informations en entrée. A ce titre, le cinquième prompt (Fig. 8) montre que les systèmes ne prennent pas en compte toujours en compte les informations qu’il a lui-même précédemment produites.

Figure 8 : « réorientation » des informations produites par les différents systèmes

Les différents prompts issus de ce tableau montrent par ailleurs que le lien avec les savoirs demeure globalement difficile. Les résultats mettent en ce sens en évidence l’existence d’un décalage entre les activités pédagogiques proposées en classe et les savoirs qu’elles peuvent permettre de manipuler. L’avant-dernier prompt relatif aux « jeux de logique et d’information » (Fig. 8) est à ce titre particulièrement évocateur. Les savoirs en viennent complètement à être oubliés. Nous sommes alors face à un cas « non-sens » lié à une incohérence factuelle où l’information est associée à une notion « nouvelle », celle de « logique » qui ne fait pas sens à réception. Là encore, la question du sens et de l’interprétation percute celle du codage.

Figure 9 : réécriture des savoirs relevant d’un « non-sens » - 2 – Google Gemini

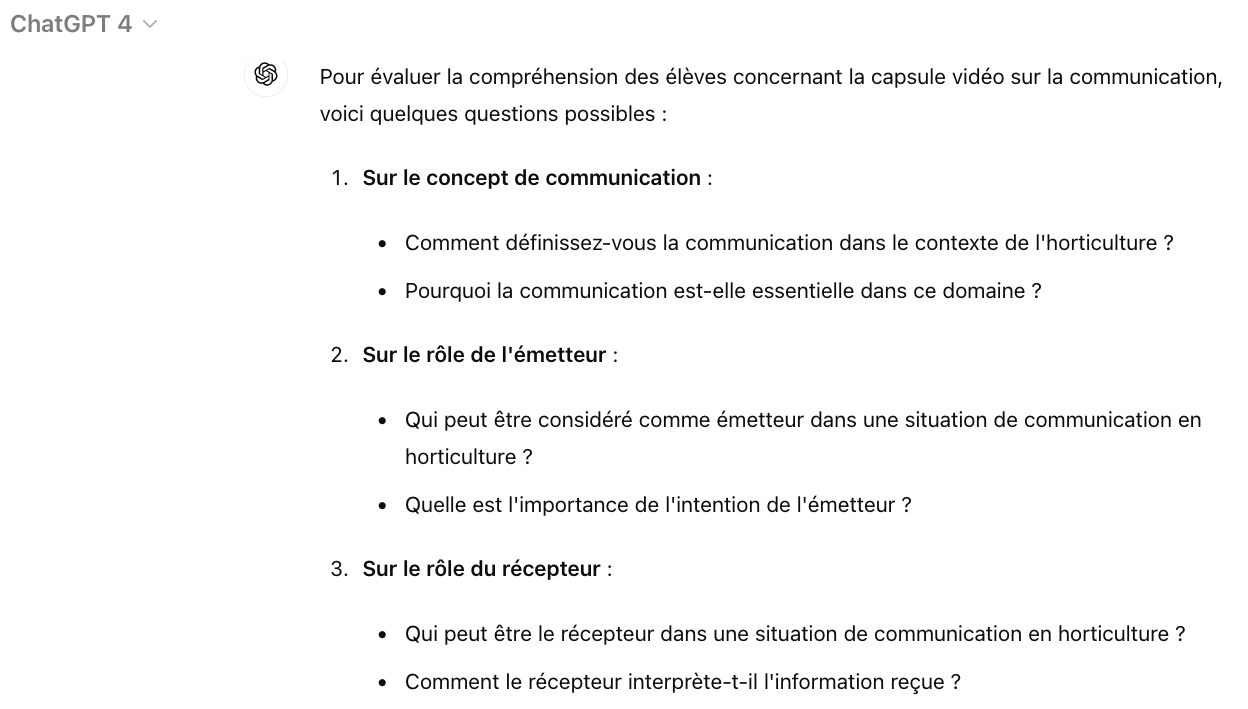

Les cas d’extrapolation ou de non-sens relevés dans la réécriture des savoirs tendent ainsi à montrer un écart entre les intentions de l’émetteur et les possibilités algorithmiques. Une analyse plus approfondie montre que cette réécriture se caractérise notamment par l’importance accordée au contexte par les systèmes. Ainsi, que ce soit dans le storyboard de la capsule vidéo ou dans les activités proposées, ces derniers prennent systématiquement appui sur le domaine horticole. Cette présence, voire cette « omniprésence », pose question car elle s’impose souvent au détriment des éléments de savoir eux-mêmes (extrapolation, non-sens). Les exemples ci-dessous sont particulièrement évocateurs. Alors qu’il est censé poser des questions relatives aux savoirs contenus dans la capsule vidéo, ChatGPT se focalise sur la communication en horticulture, diluant ainsi complètement ces derniers (Fig. 10).

Figure 10 : sur-représentation du contexte dans la réécriture des savoirs – ChatGPT

Mistral associe même les savoirs à des compétences professionnelles insistant plus sur la notion de communication que celle d’information (Fig. 11).

Figure 11 : sur-représentation du contexte dans la réécriture des savoirs - Mistral

Cette sur-représentation, qui ne faisait pas partie de la demande initiale (prompt), interroge en ce sens particulièrement la manière dont la hiérarchisation peut s’opérer dans le traitement des informations effectué par les trois agents conversationnels.

Discussion et conclusion

Cette étude avait pour principal objectif d’analyser la manière dont l’information produite par différents systèmes d’IA générative peut permettre de mettre en œuvre un processus de médiation des savoirs en vue de construire un dispositif de classe inversée pour des élèves scolarisés en baccalauréat professionnel « productions horticoles ».

Nous avons volontairement choisi un dispositif particulièrement exigeant d’un point de vue info-communicationnel car il engage des savoirs, différentes formes de réécriture et une organisation complexe d’un point de vue logistique et technique. Il requiert également une articulation fine et une progressivité entre les savoirs en jeu dans les activités à réaliser à la maison et celles en classe.

Les résultats montrent que si les informations produites par les systèmes peuvent être utiles à l’enseignant qui met en œuvre le processus notamment appréhendé d’un point de vue logistique et technique et peuvent contribuer à l’organisation du dispositif dans son ensemble, la réécriture des savoirs demeure encore trop probabiliste. Nous pouvons néanmoins mettre en avant que ces informations constituent des pistes significatives d’éléments « hétérogènes » qui demandent donc à être « assemblés » et retravaillés par l’enseignant afin de former un tout cohérent caractéristique d’un dispositif à part entière. Rappelons à ce titre la conclusion de Popenici et Kerr (2017) qui exploraient l’impact de l’intelligence artificielle sur l’enseignement et l’apprentissage dans l’enseignement supérieur, il y a déjà quelques années : « les solutions d'intelligence artificielle peuvent en effet concerner des tâches qui peuvent être automatisées, mais ne peuvent pas encore être envisagées comme une solution pour des tâches plus complexes (…) » (p. 2).

En caractérisant les différentes formes de réécriture des savoirs nous avons pu également soulever les limites l’information générée par ces systèmes. Ces dernières sont avant tout de l’ordre de la « cécité sémantique » (Andler, 2023, p. 222) et dans notre cas précisément avoir une connaissance effective de ce qu’est un élève scolarisé en première de baccalauréat professionnel agricole, de ce qu’est l’enseignement de la discipline scolaire information-documentation et de ce qu’est enseigner et apprendre en classe inversée. En effet, « la machine ne comprend rien : il est donc nécessaire qu’elle soit capable, à partir du seul enregistrement des propriétés matérielles de l’objet qu’elle traite, d’en conserver la forme à travers les divers stades d’un traitement technique » (Jeanneret, 2011, p. 60). En prenant le parti d’analyser cette information en nous appuyant sur la distinction qu’effectue Jeanneret entre information-1 et informaiton-2, nous avons cependant pu mettre en évidence que la logique du sens et de l’intention et celle des algorithmes ne vont pas toujours de pair. Le traitement partiel des informations en entrée par les systèmes, les nombreux cas de réécriture des savoirs relevant d’une extrapolation ou d’un non-sens à réception en attestent. Dans cette perspective, un des apports de cette étude concerne l’omniprésence du contexte dans la réécriture des savoirs. Ce dernier joue un rôle particulièrement paradoxal car il est à la fois nécessaire pour faire fonctionner le système de manière optimale mais peut contribuer dans le traitement qui est réalisé par la machine, à diluer voire à faire disparaître les éléments de savoirs dans la réécriture.

Plus largement, cette étude questionne la construction de la relation enseignant-machine et du travail autour de l’information qui en découle ce qui pourrait constituer un des prolongements de notre travail de recherche. Dans cette perspective, elle demande maintenant à être déployée dans d’autres dispositifs et dans d’autres disciplines que l’information-documentation. Les résultats mis en avant aujourd’hui exigent par ailleurs d’être réinterrogés dans plusieurs mois, les systèmes d’IA générative devenant quant à eux chaque jour plus performants mais nous espérons ouvrir la voie à des analyses de ces systèmes en mobilisant l’approche conceptuelle des SIC.

Bibliographie

Agamben, G. (2007). Qu’est-ce qu’un dispositif ? Rivages.

Andler, D. (2023). Intelligence artificielle, intelligence humaine : La double énigme. Gallimard.

Bender, E. M., Gebru, T., McMillan-Major, A. et Shmitchell, S. (2021). On the Dangers of Stochastic Parrots : Can Language Models Be Too Big? ????. Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency, 610-623. https://doi.org/10.1145/3442188.3445922

Berberette, E., Hutchins, J. et Sadovnik, A. (2024). Redefining « Hallucination » in LLMs : Towards a psychology-informed framework for mitigating misinformation. http://arxiv.org/abs/2402.01769

Bonnet, J. et Galibert, O. (2016). Organisations et savoirs : quelles médiations ? Communication et organisation, 49, 5-17.

Canizares, A. (2022). La circulation des savoirs dans l’enseignement de l’information-documentation : une approche systémique des concepts médiation, médiatisation et dispositif. Thèse : Sciences de l’information et de la communication, Université de Toulouse 2.

Chevallard, Y. et Joshua, M.A. (1991). La transposition didactique : du savoir savant au savoir enseigné (nouv. éd. rev. et augm.). La Pensée sauvage.

Corthésy, M. (2023). Chat GPT en entreprise, le guide complet pour maximiser votre productivité. Diateino.

Coulombe, C. et Drouin , P. (2022). Les 101 mots de l’intelligence artificielle : petit guide du vocabulaire essentiel de la science des données et de l’intelligence artificielle. DataFranca.

Crawford, K. (2023). Contre-atlas de l’intelligence artificielle : Les coûts politiques, sociaux et environnementaux de l’IA. Éditions Zulma.

Davallon, J. (2003). La médiation : la communication en procès ? Médiation et information, 19, 37-59.

Delahaye, J.-P. (2023). IA générative : ce qui se cache derrière les modèles massifs de langage. Pour la Science (555).

De Sousa Cardoso, C., et Parise, F. (2023). L’art du prompt engineering. In Guide de l’IA générative : Transformez votre quotidien professionnel à l’ère de ChatGPT, Bing, Bard, Bloom, Claude (p. 53-70). De Boeck Supérieur.

Dufour, H. (2014). La classe inversée. Technologie, 193, 44-47.

Foucault, M. (1977). Dits et écrits. Tome 2. Gallimard.

Gardiès, C. (2012). Dispositifs info-communicationnels de médiation des savoirs : cadre d’analyse pour l’information-documentation [Habilitation à diriger les recherches, Université de Toulouse 2, France].

Grinbaum, A., Chatila, R., Devillers, L., Martin, C., Kirchner, C., Perrin, J., et Tessier, C. (2023). Systèmes d’intelligence artificielle générative : Enjeux d’éthique [Rapport, Comité national pilote d’éthique du numérique]. https://cea.hal.science/cea-04153216

Henry, J. (2023). Conclusion. Dans Margarida Romero, Laurent Heiser (dir.). Enseigner et apprendre à l’ère de l’intelligence artificielle. Canopé, Livre blanc (p.94-95).

Hicks, M. T., Humphries, J. et Slater, J. (2024). ChatGPT is bullshit. Ethics and Information Technology, 26(2), 38. https://doi.org/10.1007/s10676-024-09775-5

Holmes W., Persson J., Chounta I.-A., Wasson B. et Dimitrova V. (2022). Artificial intelligence and education. A critical view through the lens of human rights, democracy and the rule of law. Council of Europe. https://rm.coe.int/artificial-intelligence-and-education-a-critical-view-through-the- lens/1680a886bd

Huang, L., Yu, W., Ma, W., Zhong, W., Feng, Z., Wang, H., Chen, Q., Peng, W., Feng, X., Qin, B. et Liu, T. (2023). A Survey on Hallucination in Large Language Models : Principles, Taxonomy, Challenges, and Open Questions. arXiv. http://arxiv.org/abs/2311.05232

Jeanneret, Y. (2005). Dispositif. Dans Commission de la République française pour l’éducation, la science et la culture, La « société de l’information » : glossaire critique (p. 50-51). La Documentation française.

Jeanneret, Y. (2009). La relation entre médiation et usage dans les recherches en information-communication en France. Reciis, 3(3). https://doi.org/10.3395/reciis.v3i3.276fr

Jeanneret, Y. (2011). Y-a-t-il (vraiment) des technologies de l’information ? [1er éd. 2001]. Presses Universitaires du Septentrion.

Lamizet, B. et Silem, A. (dir.). (1997). Dictionnaire encyclopédique des sciences de l’information et de la communication. Ellipses.

Lebrun, M. et Lecoq, J. (2015). Classes inversées : enseigner et apprendre à l’endroit ! Canopé éditions.

Mc Luhan, M. (1968). Pour comprendre les médias : les prolongements technologiques de l’homme. Paris : Seuil

Meunier, J.-P. (1999). Dispositif et théories de la communication : deux concepts en rapport de codétermination. Hermès, 25, 83-91.

Meyriat, J. (1983). De la science de l’information aux métiers de l’information. Schéma et schématisation, 19, 65-74.

Novice-Béatrix, Aurélia (2023). L’IA, une plus-value qui ne remplace pas l’enseignant. Dans Frédérique Guénot (dir.) L’IA éducative : l’intelligence artificielle dans l’enseignement supérieur. Bréal (p. 176-180).

Perret, A. (2024). ChatGPT et l’indifférence à la vérité. Disponible sur : https://www.arthurperret.fr/blog/2024-06-21-chatgpt-et-l-indifference-a-la-verite.html

Popenici, S. A. D. et Kerr, S. (2017). Exploring the impact of artificial intelligence on teaching and learning in higher education. Research and Practice in Technology Enhanced Learning, 12(1), 22. https://doi.org/10.1186/s41039-017-0062-8

Simonnot, B. (2014). Médiations et agir informationnels à l’ère des technologies numériques. Les cahiers d’esquisse, 4, 21-23.

Smith, A. L., Greaves, F. et Panch, T. (2023). Hallucination or Confabulation? Neuroanatomy as metaphor in Large Language Models. PLOS Digital Health, 2(11). https://doi.org/10.1371/journal.pdig.0000388

Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., Kaiser, L. et Polosukhin, I. (2017). Attention is all you need. https://doi.org/10.48550/ARXIV.1706.03762

Villani, C. (2018). Donner un sens à l’intelligence artificielle (IA) : rapport. https://www.enseignementsup-recherche.gouv.fr/fr/rapport-de-cedric-villani-donner-un-sens-l-intelligence-artificielle-ia-49194

Zhang, Y., Li, Y., Cui, L., Cai, D., Liu, L., Fu, T., Huang, X., Zhao, E., Zhang, Y., Chen, Y., Wang, L., Luu, A. T., Bi, W., Shi, F. et Shi, S. (2023). Siren’s Song in the AI Ocean : A Survey on Hallucination in Large Language Models. http://arxiv.org/abs/2309.01219

Télécharger l'article

Télécharger l'article

Contacter l'auteur

Contacter l'auteur

Lire la suite

Lire la suite